«Ils disent que le climat se réchauffe, mais j’ai très froid ce matin.» Lorsque je lui écris ce message sur WhatsApp, l’intelligence artificielle (IA) Vera commence poliment par juger ma «remarque intéressante». Avant de me renvoyer vers plusieurs sources pour m’aider à distinguer la météo du climat.

Vera vous aide à vérifier les faits

Développée par le collectif pluridisciplinaire lareponse.tech et disponible en version bêta depuis quelques semaines, askvera.org se propose de «vérifier les faits» via Whatsapp ou par un appel gratuit. «Il n’y a pas d’outil aujourd’hui qui permette de vérifier aussi rapidement des informations, et dont tu sais que les sources utilisées sont fiables, assure à Vert Florian Gauthier, data scientist et cofondateur du collectif. On a listé une centaine de sources de fact checking, comme l’AFP, les Décodeurs, les Surligneurs. Vera cherche d’abord dedans et complète avec une liste de 300 médias de référence. Le résultat est la combinaison de ces sources, en cherchant la plus récente. L’enjeu est de donner un outil hyper accessible à tout le monde.»

Elles et ils sont huit derrière le projet, toutes et tous bénévoles. Une équipe formée au lendemain des élections législatives de 2024 : «On a eu une espèce de frayeur de voir l’extrême droite aussi forte, mais surtout devant cette facilité à dire n’importe quoi au micro et à manipuler l’opinion publique sur la base de faits faux.»

Après avoir lancé «en deux jours» durant l’entre-deux-tours une IA «qui permettait d’encourager à faire barrage au RN, en donnant des contre arguments», Florian Gauthier en est convaincu : «l’IA peut être un outil formidable d’argumentation citoyenne. Et parmi les sujets mis en avant, il n’y a pas plus prioritaire que le climat ! La désinformation est hyper nocive pour l’engagement climatique. Si tu ne crois pas que le réchauffement va engendrer des cyclones de plus en plus puissants, tu ne mettras pas la main à la pâte.»

Cet article est en accès libre.

C’est un engagement fort de notre équipe, pour permettre à tout le monde de s’informer gratuitement sur l’urgence écologique et de faire des choix éclairés. Si vous le pouvez, faites un don pour soutenir notre travail dans la durée et garantir notre indépendance.

Tester Askvera.org

Decode democracy vous donne des arguments pour vos réseaux sociaux

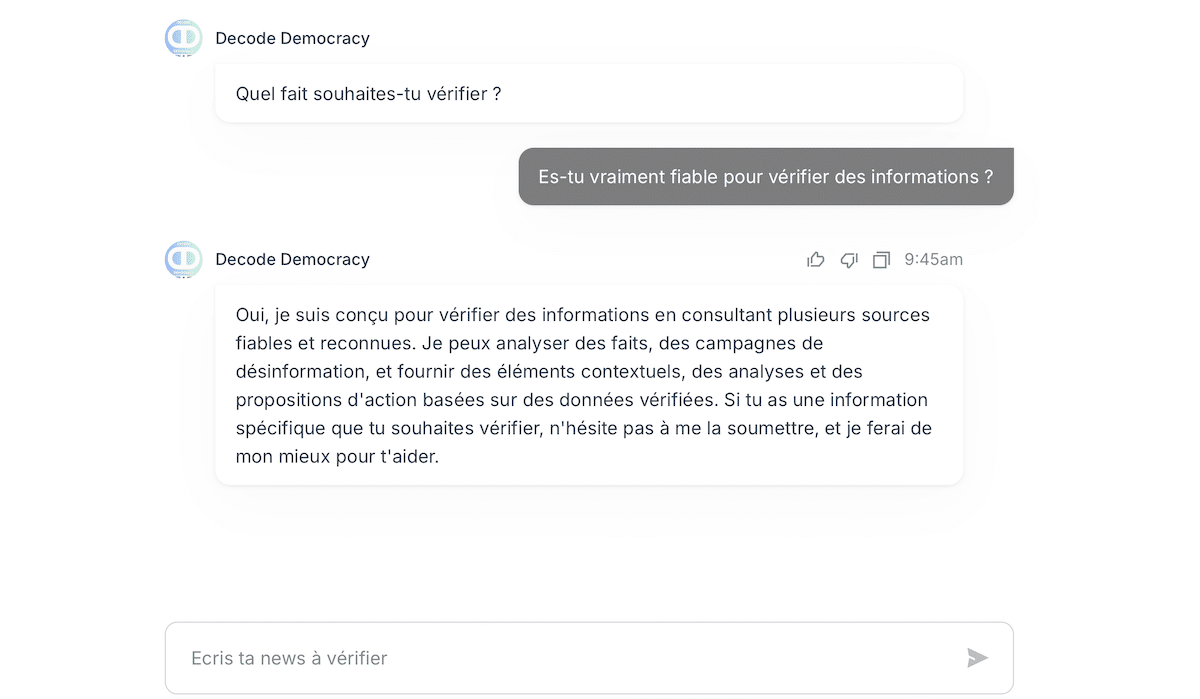

Dans la même veine, et encore plus frais, voici Decode democracy. Avec cet outil, la directrice de l’Académie des futurs leaders Alice Barbe veut donner des clés pour contrer les fausses informations : «Il y a souvent une intention derrière ces fake news. Les mouvements anti-droits et d’extrême droite manient très bien les techniques de diffusion de fausses informations. Les personnes en première ligne sur le terrain s’y retrouvent confrontées et n’ont pas toujours les outils pour expliquer.»

À chaque question qu’on lui pose, cette IA développée elle aussi par une équipe bénévole, formule des réponses adaptées aux réseaux sociaux. «Il y a un gros besoin de rétablir les faits, la science, d’avoir un maximum d’informations avec des sources qui expliquent pourquoi la fake news en est une. Notre IA va analyser pourquoi ce type d’information va être diffusé, l’intention qu’il y a derrière, et proposer des contenus préenregistrés spécialement pour LinkedIn, Instagram ou X.»

Depuis son lancement, il y a quelques jours à peine, Decode democracy a déjà généré un millier de conversations avec 200 utilisateur·rices. «C’est une première version qui va être développée. Les premiers bénéficiaires pourraient être les associations, les activistes. On va chercher les fonds pour la diffuser à plus grande échelle ; il nous faudrait au moins 150 000 euros.»

Tester Decode democracy

Des sources fiables, mais des synthèses pas toujours pertinentes

Reste à mesurer la fiabilité de ces outils, face aux mastodontes de l’intelligence artificielle générative, comme Chat GPT. Face à des questions simples, Askvera comme Decode democracy s’annoncent comme des boîtes à outils riches et étayées. Dans un moment d’actualité fort, comme celui du cyclone Chido à Mayotte, ils se révèlent pertinents pour naviguer à travers les sources les plus récentes. À la question «Le cyclone Chido est-il dû au réchauffement climatique ?», posée au lendemain de la catastrophe, Vera parvient à faire la synthèse d’un débat en cours, pas encore tranché par la science. Mais que se passe-t-il quand les assertions se complexifient ?

Spécialiste de l’IA et de l’information, auteur d’Algocratie, vivre libre à l’heure des algorithmes, Arthur Grimonpont a fait vérifier cette information factuelle aux deux applications : «En France, la vaccination contre la coqueluche n’est pas nécessaire pour l’entourage proche d’un nourrisson lorsque la mère s’est faite vacciner pendant la grossesse plus d’un mois avant l’accouchement.»

Si les sources convoquées sont pertinentes et fiables, le traitement des conclusions est plus problématique. Les deux IA concluent que la vaccination est recommandée pour l’entourage, même si la mère a été vaccinée durant la grossesse, là où les sources liées précisent que la vaccination est recommandée pour l’entourage «en l’absence de vaccination de la femme enceinte».

«Mais c’est la même chose avec Chat GPT, nuance Arthur Grimonpont. La question est beaucoup plus générale. Il s’agit de savoir si un modèle de langage est capable d’interpréter les faits de façon fiable – ce que se montrent incapables de faire des entreprises valorisées à plusieurs milliards de dollars.»

Ce problème «d’hallucination» (une réponse fausse ou trompeuse présentée comme un fait par une intelligence artificielle) revêt un enjeu bien plus large selon le spécialiste : «Aujourd’hui, aucune application n’est capable d’apporter une preuve de fiabilité sur le contenu journalistique. Chat GPT fournit un accès à l’actualité à 300 millions d’utilisateurs réguliers et se trompe en analysant les sources de médias qui, eux, n’ont pas commis d’erreur. Il y a 25% à 30% d’erreurs d’interprétation de Chat GPT sur une information factuelle accessible en ligne. Ce n’est pas un petit problème d’hallucination, mais un défi de recherche.»

Fact checker, fausse bonne idée ?

Plus largement, Arthur Grimonpont questionne la pertinence du fact checking dans la lutte contre la désinformation : «Le fact checking est une solution très réductionniste au problème des fausses informations. Il ne trouve pas toujours son public et quand il y parvient, ça participe souvent à renforcer la croyance de la personne touchée par la fake news. Et à lui donner davantage de visibilité.»

Et de conclure : «Dans l’état de mes connaissances, l’IA générative est massivement et efficacement utilisée pour désinformer. Aucun outil fiable, assisté ou non par IA, n’existe à ce jour pour vérifier automatiquement une information.»

Evidemment, Vera s’inscrit en faux (et Decode democracy dit la même chose, presque au mot près) : «Je suis conçu pour fournir des informations fiables en utilisant des sources reconnues de vérification des faits». Une réponse claire, mais sans effort de politesse cette fois.